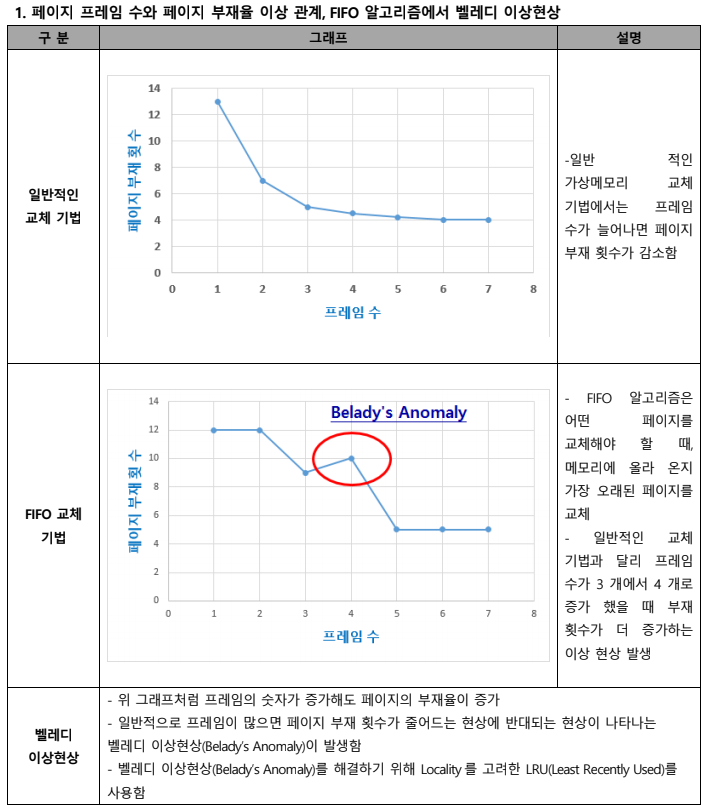

2. FIFO 이상현상의 예시 (012301401234)

'ITPE > CA_OS' 카테고리의 다른 글

| Hypervisor (0) | 2021.04.28 |

|---|---|

| 페이징 기법 및 TLB (0) | 2021.04.28 |

| Cache Clean, Flush (0) | 2021.04.28 |

| MESI protocol (0) | 2021.04.28 |

| CPU 명령어 사이클 (0) | 2021.04.27 |

2. FIFO 이상현상의 예시 (012301401234)

| Hypervisor (0) | 2021.04.28 |

|---|---|

| 페이징 기법 및 TLB (0) | 2021.04.28 |

| Cache Clean, Flush (0) | 2021.04.28 |

| MESI protocol (0) | 2021.04.28 |

| CPU 명령어 사이클 (0) | 2021.04.27 |

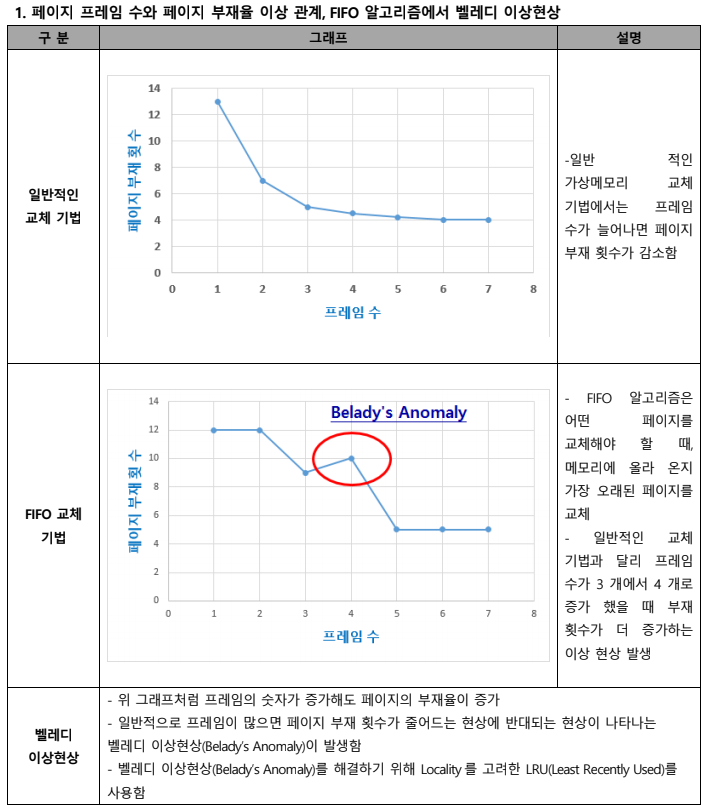

[정의] 논리주소를 페이지 테이블을 이용하여 물리주소로 변경하여 메모리에 접근하는 방법

[논리주소] Process에서 사용하는 주소. Page number(p), page offset(d, 각 변수의 위치) 으로 구성

[물리주소] 실제 메인메모리를 frame 라고 하고 frame 위치에 저장된 주소

[변환방법] 그림참조

- 페이지 테이블에는 frame 번호가 저장.

[문제점] 페이지 테이블이 실제로 물리 메모리에 위치하고있어 두번 메모리 접근하여 성능 문제 발생

-> TBL를 이용하여 문제 해결 가능

[TLB] MMU 내부에 page table만 이용하는 공간 할당된 버퍼. Page table의 일부 내용만 저장.

[TLB 작동원리] 전체 검색후 윈하는 페이지를 찾고, 데이터의 위치를 찾음(P,D를 동시 저장).

- 전체 검색시에 검색시간 소요되므로, 전체를 비교가능한 캐시의 구조를 이용함.

[TLB를 이용한 주소변환] 그림참조

- TLB를 우선 찾고, TLB HIT 일때, 같이 저장된 frame을 가져와서 물리주소 구성

- TLB Miss 일때, Page table 찾아 물리주소 구성.

- TLB Miss 일때, 찾아온 물리주소를 새로 저장하기 위해 항목교체 알고리즘 필요

(LRU, FIFO, Random 등등)

- Process가 교체될때(문맥교환시) TLB 전체가 교체되어야함. 이럴때 Thrashing 발생가능하므로,

여러 Process의 내용을 동시에 보관하는 방법을 사용(Address-space Identifier(ASID))

[크기가 큰 페이지 테이블의 처리]

- 계층적 페이징, 해시 페이지 테이블, 역 페이지 테이블

| Hypervisor (0) | 2021.04.28 |

|---|---|

| Belady’s Anomaly (0) | 2021.04.28 |

| Cache Clean, Flush (0) | 2021.04.28 |

| MESI protocol (0) | 2021.04.28 |

| CPU 명령어 사이클 (0) | 2021.04.27 |

| Belady’s Anomaly (0) | 2021.04.28 |

|---|---|

| 페이징 기법 및 TLB (0) | 2021.04.28 |

| MESI protocol (0) | 2021.04.28 |

| CPU 명령어 사이클 (0) | 2021.04.27 |

| CPU 구성 (0) | 2021.04.24 |

| 페이징 기법 및 TLB (0) | 2021.04.28 |

|---|---|

| Cache Clean, Flush (0) | 2021.04.28 |

| CPU 명령어 사이클 (0) | 2021.04.27 |

| CPU 구성 (0) | 2021.04.24 |

| 개요 (0) | 2021.04.24 |

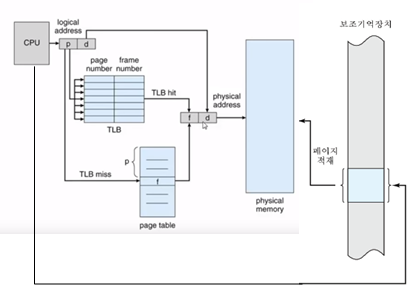

1. 명령어 사이클 메이저 상태 4가지

2. 명령어 사이클 설명

3. 인출 사이클 동작의 마이크로 연산

t1 : PC의 내용을 MAR에 이동

t2 : MAR에 의하여 지정된 기억장소의 내용을 MBR로 이동하고, PC의 내용을 I만큼 증가

t3 : MBR의 내용을 IR로 이동

3-1. ADD 명령어 실행 사이클에서의 마이크로 연산

4. 간접(inditect) 사이클 동작의 마이크로 연산

t1 : 명령어의 주소 필드는 MAR로 이동, 오퍼랜드의 주소 인출을 위해 사용됨

t2 : MAR에 의하여 지정된 기억장소의 내용을 MBR로 이동

t3 : IR의 주소 필드가 MBR로부터 들어오는 주소로 갱신, 따라서 그것은 간접주소가 아닌 직접 주소를 가지게 됨

5. 인터럽트(interrupt) 사이클 동작의 마이크로 연산

t1 : PC의 내용이 MBR로 보내져서 인터럽트 수행이 끝난 후 복귀(return)할 때 사용가능하도록 함

t2 : MAR에는 PC의 내용이 저장될 위치의 주소가 적재. PC에는 인터럽트-처리 루틴의 시작주소가 적재

t3 : PC의 이전 값을 가지고 있는 MBR의 내용을 기억장치에 저장

| Cache Clean, Flush (0) | 2021.04.28 |

|---|---|

| MESI protocol (0) | 2021.04.28 |

| CPU 구성 (0) | 2021.04.24 |

| 개요 (0) | 2021.04.24 |

| 자동차 ecu의 이해 (펌글) (0) | 2017.12.21 |

| Cache Clean, Flush (0) | 2021.04.28 |

|---|---|

| MESI protocol (0) | 2021.04.28 |

| CPU 명령어 사이클 (0) | 2021.04.27 |

| 개요 (0) | 2021.04.24 |

| 자동차 ecu의 이해 (펌글) (0) | 2017.12.21 |

| Cache Clean, Flush (0) | 2021.04.28 |

|---|---|

| MESI protocol (0) | 2021.04.28 |

| CPU 명령어 사이클 (0) | 2021.04.27 |

| CPU 구성 (0) | 2021.04.24 |

| 자동차 ecu의 이해 (펌글) (0) | 2017.12.21 |

I. 데이터의 직관적인 분포, 박스 플롯의 개념

- 자료들의 최대값과 최소값, 중앙값, 사분위수 등을 이용하여 자료의 측정값들이 어떤 모양으로 분포되어 있으며, 이상치 등을 쉽게 파악할 수 있는 도표

II. 박스플롯의 구성도 및 설명

가. 박스플롯의 구성도 및 용어

|

용어 | 설명 |

| 사분위 | 자료를 작은 값으로부터 4등분 | |

| IQR | 1사분위와 3사분위의 차이 | |

| Outlier | Max와 Min 범위를 벗어나는 값 | |

| 최대값 | 1사분위에서 1.5 IQR을 뺀 것 | |

| 최소값 | 3사분위에서 1.5 IQR을 더한 것 | |

| 중간값 | 2사분위수로 중간값 | |

| 평균값 | 전체 자료의 평균으로 (+)로 표기 |

나. 박스플롯의 작성 절차

| 절차 | 설명 |

| 사분위 계산 | 데이터의 사분위수를 계산 |

| 박스 생성 | 1사분위수와 3사분위수를 이용하여 박스를 생성. 박스의 길이는 IQR임 |

| 중간값 표기 | 2사분위수에 해당하는 위치에 선을 그림 |

| 최대값 및 최소값 표기 | 3사분위수에서 1.5IQR을 더한 위치와, 1사분위수에서 1.5IQR을 뺀 위치 |

| 이상값 표기 | 최대값 및 최소값의 범위를 넘어가는 자료는 기호로 표시 |

- 박스플롯 이용시 데이터의 분포를 쉽게 확인가능

| 강화학습(Reinforcement learning) 기본 내용 (2) | 2025.02.06 |

|---|---|

| 혼동 행렬(confusion matrix)을 이용한 분류 모형의 평가지표 (0) | 2021.04.09 |

| LSTM (0) | 2021.04.09 |

혼동행렬

• TP(True Positives) : 실재값과 예측치 모두 True 인 빈도

• TN(True Negatives) : 실제값과 예측치 모두 False 인 빈도

• FP(False Positives) : 실제값은 False 이나 True로 예측한 빈도

• FN(False Negatives) : 실제값은 True 이나 False로 예측한 빈도

- 정분류율(accuracy, recognition rate) : 전체 관측치 중 실제값과 예측치가 일치한 정도를 나타낸다. 정분류율은 범주의 분포가 균형을 이룰 때 효과적인 평가지표이다. (TP+TN)/(TP+TN+FP+FN)

- 민감도(sensitivity) = TP/(TP+FN) ==> 실제값이 True 인 관측치 중 예측치가 적중한 정도

- 특이도(specificity) = TN/(FP+TN) ==> 실제값이 False 인 관측치 중 예측치가 적중한 정도

- 정확도(precision) = TP/(TP+FP) ==> True로 예측한 관측치 중 실제값이 True 인 정도. 정확성 지표

- 재현율(recall) = TP/(TP+FN) = 민감도 ==> 실제값이 Ture 인 관측치 중 예측치가 적중한 정도. 모형의 완전성을 (completeness)을 평가

- F1 Score = (2*precision*recall) / (precision+recall) ==> 정확도와 재현율의 조화평균. 정확도와 재현율에 같은 가중치를 부여하여 평균

| 강화학습(Reinforcement learning) 기본 내용 (2) | 2025.02.06 |

|---|---|

| Boxplot (0) | 2021.04.12 |

| LSTM (0) | 2021.04.09 |

[정의] RNN에서 학습방법의 역전파 거리가 늘어날경우 gradient값이 폭증하거나 사라지는 문제점을 개선하는 알고리즘

[RNN의 장기의존성(Long-Term Dependency) 문제] 이전 정보입력 위치와 현재 입력위치가 멀 경우 학습데이터 유실되는 문제

※ tanh : Hyperbolic Tangent. 시그모이드 함수를 조금 변형하여 1 ~ -1까지 출력되는 함수. 시그모이드보다 기울기가 가파라서 학습속도가 빠르지만, 양끝단 포화가 더 심하여, Vanishing Gradient 문제에서는 취약함.

※ 시그모이드 3개는 단지 아날로그적 스위치 역할수향. 노드의 전달 함수는 하이퍼탄 이용.

| 강화학습(Reinforcement learning) 기본 내용 (2) | 2025.02.06 |

|---|---|

| Boxplot (0) | 2021.04.12 |

| 혼동 행렬(confusion matrix)을 이용한 분류 모형의 평가지표 (0) | 2021.04.09 |